一、客户挑战:超大规模智算集群的建设

该智算中心该超大型智算中心项目在规划与实施阶段面临三重核心挑战:

1. 极致性能的网络需求:气候模拟、药物研发等任务需大规模并行计算与海量数据交互, 要求网络具备400Gbps计算带宽、200Gbps存储带宽与亚微秒级延迟;

2. 跨机房部署的物理限制:计算与存储分属A、B机房,需在3个月内完成集成,并克服 200G AOC 线缆 100 米传输距离限制;

3. 施工环境的适应性挑战:原上走线设计与实际下走线环境冲突,线槽狭窄、焊接式设计穿线困难,严重影响进度与质量。

二、我们的解决方案:系统性构建高效可靠的 AI 算力集群

针对上述挑战,我公司基于在智算中心建设领域的丰富经验,提出了一系列创新性解决方案:

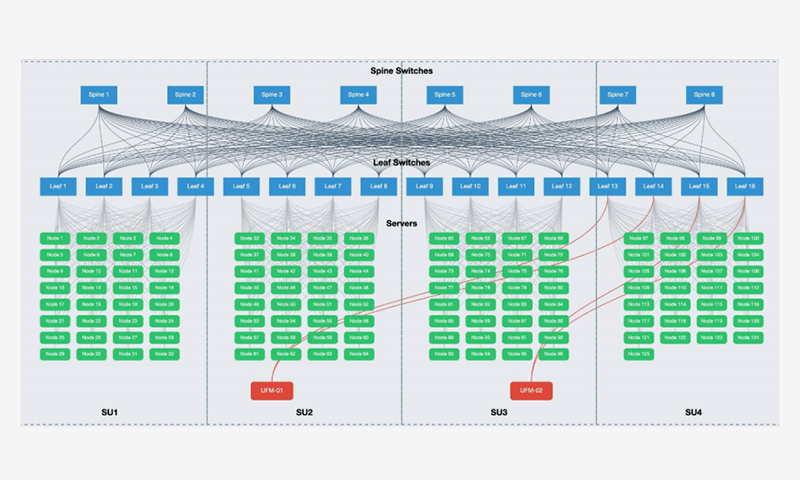

1. 高速计算网络-400G NDR InfiniBand 架构:

采用 NVIDIA Quantum QM9790 交换机构建无阻塞胖树网络拓扑(8 台 Spine + 16 台 Leaf),通过 1000 余条 400G MPO 线缆(总长达 20 公里)实现超高密度互连,提供超低延迟与近乎线性的扩展能力,彻底消除 GPU 通信瓶颈。

2. 高性能存储网络-200G HDR InfiniBand 架构:

部署 NVIDIA Quantum QM8790 交换机构建 Spine-Leaf 架构(10 台 Spine + 11 台 Leaf), 使用 400 余条 200G AOC 线缆实现多路径并行访问,显著提升 I/O 并发效率,支撑 1TB/s 级数据吞吐,满足海量训练数据与模型检查点的极致读写需求。

3. 智能运维平台-NVIDIA UFM 统一管理:

引入 NVIDIA UFM®平台,实现实时网络监控、自动化故障诊断、流量优化与预防性维护, 大幅提升运维效率与系统可靠性。

4. 复杂环境下的工程实施优化:

面对跨机房布线、线缆长度限制与施工环境冲突等挑战,我们通过:

· 精确测量与仿真推演,确保所有跨机房线缆控制在 100 米内;

· 采用特殊保护套管与冗余布线,保障物理连接安全;

· 将焊接式线槽改造为卡扣式设计,提升穿线效率;

· 多工序并行施工与增派人力,在极短时间内完成高密度布线任务。

三、项目成果:为客户带来的卓越价值

集群交付后,该智算中心在多个维度表现出色:

· 极致性能表现:系统实现 1TB/s 级数据流动,支撑千亿参数模型训练与大规模科学计算;

· 稳定运行记录:依托 UFM 平台,实现网络零宕机,提前发现并规避潜在故障;

· 多领域科研突破:已支撑气象预报、海洋模拟、药物研发、工业仿真、深空探测等多个国家级重大项目,显著加速研发进程。

四、总结

本项目成功展示了正阳恒卓在超大规模智算中心建设中的技术实力与系统整合能力。通过将 NVIDIA 最新硬件与自研优化方案相结合,我们不仅交付了一套高性能、高可靠的算力基础设施,更为客户提供了面向未来的智能化运维体系与科研赋能平台,助力其在 AI 与科学计算领域持续领先。